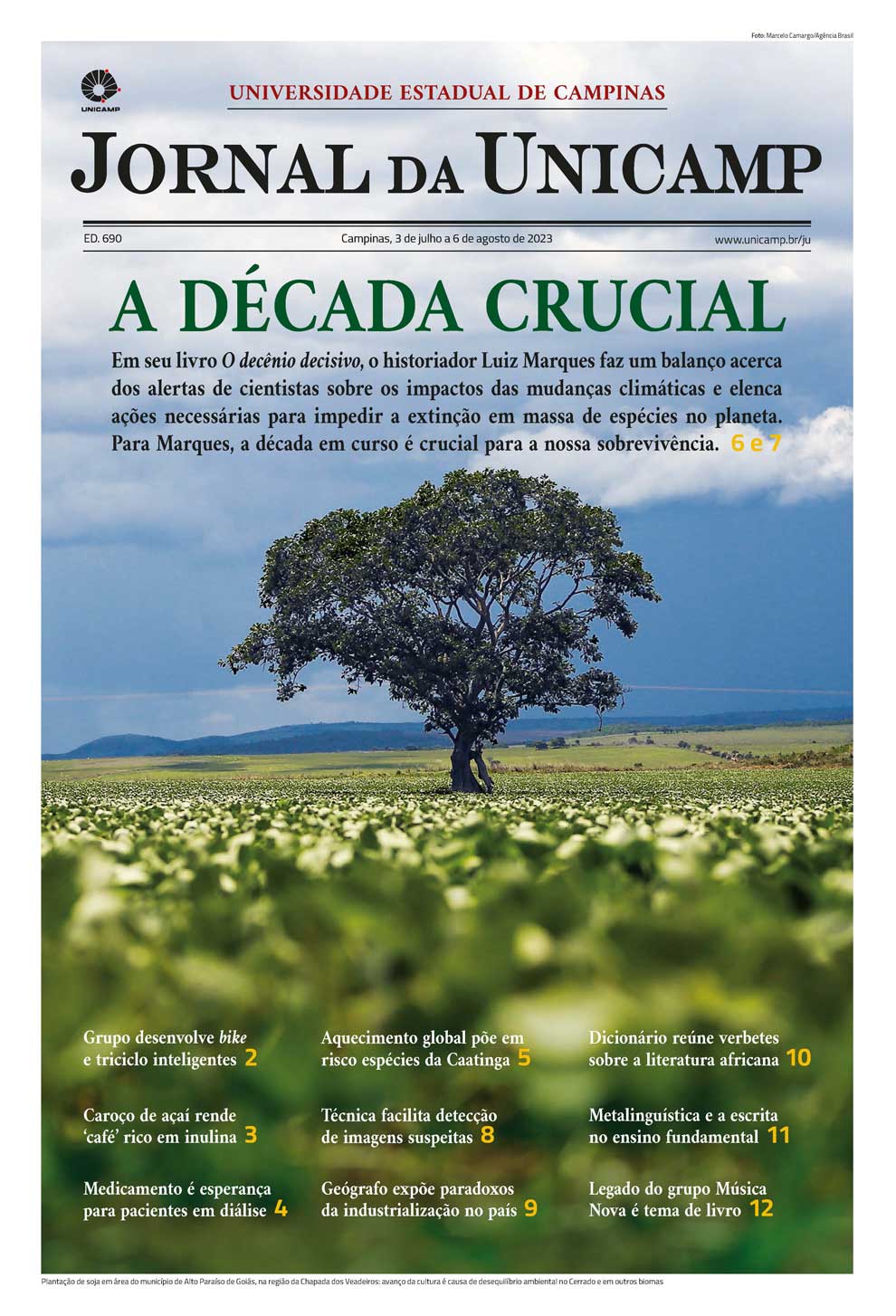

Projeto desenvolve ferramentas que permitem identificar conteúdos sensíveis

Em investigações sobre casos de abuso sexual infantil, analisar fotografias encontradas em computadores de suspeitos é um trabalho desumano – seja pela quantidade de imagens armazenadas, seja pelo conteúdo das fotos. Para tornar essa atividade menos desgastante, o pesquisador Pedro Valois, em um mestrado realizado no Instituto de Computação (IC) da Unicamp, desenvolveu um programa que automatiza a detecção de imagens suspeitas.

Resultado dessa pesquisa, a dissertação “Aprendizado Autossupervisionado para Reconhecimento de Cenas em Imagens de Abuso Sexual Infantil” ficou em primeiro lugar no Prêmio de Reconhecimento Acadêmico em Direitos Humanos Unicamp – Instituto Vladimir Herzog (categoria Ciências Exatas, Engenharia e Tecnologia). Recebeu, ainda, uma carta de congratulação da Câmara Municipal de Campinas.

Para Valois, a premiação consagra todo o projeto em que seu mestrado se insere e é fruto de uma parceria entre o Laboratório de Inteligência Artificial e Inferência em Dados Complexos (Recod. ai), da Unicamp, e a Universidade Federal de Minas Gerais (UFMG). Lançado e coordenado pela professora Sandra Avila, do IC, e pelo professor Jefersson dos Santos, da UFMG, o projeto dedica-se ao desenvolvimento de ferramentas que permitam identificar conteúdos sensíveis em ambientes digitais. “O prêmio é importante porque dá visibilidade [ao combate a casos de abuso sexual infantil], pois, quando se fala sobre a pesquisa do Pedro, também está se falando sobre o tema. Assim, conseguimos atingir uma quantidade de pessoas que não imaginávamos”, observa Avila, que orientou o mestrado em parceria com Santos.

Projeto de muitas funções

Segundo Valois, a pesquisa, inédita, começou quando ele notou que praticamente não existia automação nesse campo. “É realmente muito difícil [criar soluções que automatizem o reconhecimento de cenas], porque se trata de um conteúdo proibido, ao qual somente a polícia tem acesso; e é assim no mundo inteiro”, justifica. Para conseguir concretizar seu projeto com sucesso, revelou, a escolha da metodologia foi fundamental. “O aprendizado autossupervisionado de máquina se desenvolveu recentemente. Durante a época do meu mestrado, muitos artigos estavam sendo publicados sobre essa metodologia. Analisando essa literatura, chegamos à conclusão de que seu uso poderia trazer benefícios quando comparado à metodologia tradicional.”

Além de tornar possível e economicamente viável identificar milhões de conteúdos suspeitos em tempo hábil, o programa desenvolvido por Valois – denominado classificador – poupa os policiais de um trabalho psicologicamente danoso. “Esse foi um projeto que teve muitas funções. O abuso sexual infantil ataca a dignidade da vítima, marcando para sempre sua vida, e afeta profundamente quem trabalha com isso”, opina o pesquisador. Sua orientadora lembra, ainda, que a técnica empregada permitiu aos envolvidos tratar da questão sem, no entanto, precisar entrar em contato direto com o conteúdo. “Enxergar o problema de forma que se consiga resolvê-lo sem precisar lidar com ele o tempo todo foi um diferencial”, diz Avila.

Hoje fazendo doutorado em ciência da computação na Universidade de Tsukuba (Japão), Valois acredita que seu mestrado não sairia do papel não fosse outro detalhe fundamental: a colaboração de peritos da Polícia Federal (PF) – alunos de programas de pós-graduação do IC e da UFMG – ao longo da pesquisa. A realização de encontros quinzenais com o grupo viabilizou a obtenção de informações necessárias para definir os tipos de ambiente e cena presentes nas imagens que poderiam estar associados a casos de assédio sexual infantil e que, portanto, deveriam ser selecionadas por seu classificador.

Diferenciar o que é suspeito do que não é mostra-se uma tarefa complicada tanto pelo detalhamento como pelo volume do material, revela Avila. Após muitas horas em frente a uma tela, sendo exposto a uma infinidade de imagens e trabalhando em um estado de tensão constante, é comum que o encarregado da investigação deixe passar um detalhe que mereceria investigação. “A técnica utilizada por Pedro permite usar um volume bastante grande de dados [imagens] sem que seja necessário passar para o programa informações específicas sobre o conteúdo.” Além de poupar a exposição a esse material, consegue-se chegar a um resultado mais robusto e confiável.

Padrões de diferenciação

O classificador passou por uma longa fase de treinamento, para o qual foram utilizadas 300 mil imagens previamente rotuladas e 6 milhões não rotuladas (ou seja, que não haviam sofrido qualquer classificação prévia), até o programa ser capaz de reconhecer padrões nas fotos.

O classificador também foi treinado para fazer uma “correlação de cenas”, porque as máquinas apreendidas pela polícia costumam armazenar fotografias de mais de um tipo de crime sexual. “É importante considerar a natureza contextual desses crimes. Talvez a primeira imagem de uma criança que o perito encontrar no computador não sinalize um abuso. Contudo, mais para a frente, ele pode ver outra foto, ou mais de uma, com a mesma criança, em situação de abuso. É muito difícil ter uma condenação por causa de uma imagem. A quantidade [de imagens] pesa. Por isso é preciso usar esses modelos automáticos, porque com eles se consegue aumentar o volume e, assim, a força das provas”, explica Valois.

Finalizado o treinamento, o classificador foi testado em dois momentos distintos: inicialmente de forma controlada e, depois, na “vida real”. O primeiro aconteceu no próprio laboratório do Recod.ai. Depois dele, houve um segundo teste, realizado por um dos peritos, de dentro de uma delegacia da PF. Para tanto, foram utilizados conteúdos de um banco de dados sigiloso que contém 40 mil imagens apreendidas.

Nos testes realizados no laboratório, de acordo com o pesquisador, a ferramenta classificou cenas de ambientes internos com 71,6% de precisão. Um desempenho, em média, 2,2% melhor do que o obtido com o modelo tradicional de aprendizado supervisionado, ressalta Valois. Os resultados confirmaram, ainda, hipóteses levantadas na literatura sobre os padrões de diferenciação entre uma cena de abuso sexual grave e uma cena que sugeria abuso sexual. “São muito distintas. Casos suspeitos ocorrem em ambientes que parecem o de um ensaio de fotos, como um estúdio fotográfico. Já nos mais graves havia um quarto infantil, banheiro. Pelas cenas, era possível ver o padrão”, finaliza.